Answer Engine Optimization (AEO): Der Praxisleitfaden für 2026

Kurzfassung: Answer Engine Optimization (AEO) ist kein „nächstes großes Ding“. Es ist das alte SEO-Versprechen – nur mit härterem Scoreboard: Können ChatGPT, Google AI Mode, Perplexity und Claude Ihren Namen nennen, Sie zitieren und qualifizierte Besucher schicken, wenn ein Käufer nach einer Antwort fragt?

Ich habe das gleiche Muster aus drei Blickwinkeln beobachtet: Kundenprojekte bei mindnow, meinen eigenen Traffic auf vadimkravcenko.com und produktgetriebenes SEO bei seojuice.io. Der Fehler bestand darin, AEO als neuen Kanal statt als Messproblem zu behandeln. Content hatten wir bereits. Wir wussten nur nicht, ob KI-Systeme ihm genug vertrauten, um ihn zu wiederholen.

Die aktuelle SERP erledigt einen Teil der Arbeit. Reddit liefert die Straßenperspektive: Mach Inhalte verständlich, vertrauenswürdig und von KI-basierten Answer Engines auffindbar. Forbes stellt AEO als Marken-Visibility dar – näher am Business-Problem. Coursera liefert die Einsteigerdefinition: für frageförmige Suchanfragen optimieren. Alle drei übersehen das Operator-Problem. Sie vermischen Erwähnungen, Zitationen, Links, Klicks und Umsatz zu einem vagen Begriff namens „Sichtbarkeit“.

AEO ist älter als ChatGPT – und das ist entscheidend

AEO begann nicht erst mit dem Hype um ChatGPT. Jason Barnard, CEO und Gründer von Kalicube, führt den Begriff Jahre vor dem aktuellen KI-Suchrausch zurück.

„2017 habe ich den Begriff Answer Engine Optimization geprägt.“

Diese Herkunft ist wichtig, weil AEO ein Gegenentwurf zur „zehn blaue Links“-Denke war. Das alte Versprechen lautete: für Suchanfragen ranken. Die neue Messlatte ist härter – in Antworten genannt, als Quelle zitiert und vertrauenswürdig genug sein, um die Synthese zu überstehen.

Featured Snippets, Knowledge Panels, Voice Search und „People Also Ask“ schlugen diese Richtung längst ein. LLMs machten die Verschiebung offensichtlich. Sie stellen die Antwort direkt vor den Nutzer und zwingen Marken zur unbequemen Frage: Wenn das System den Markt zusammenfasst – tauchen wir auf?

Wie AEO von SEO abhängt

Bei mindnow war die spätere AEO-Arbeit selten Magie. Es war langweilige Klarheit: Service-Pages, die die Kauffrage beantworten, Source-Pages, die die Aussage belegen, und interne Links, die Themenbezüge klar machen. seojuice.io existiert, weil genau dort die meisten Sites still Autorität verlieren.

AEO und SEO nutzen dieselbe Infrastruktur. Crawl-Fähigkeit zählt weiterhin. Seitenqualität zählt weiterhin. Links zählen weiterhin. Der Unterschied liegt im sichtbaren Ergebnis. Im klassischen SEO kämpft man um ein Ranking. In AEO kämpft man um die Auswahl innerhalb einer generierten Antwort.

Was Answer Engine Optimization tatsächlich bedeutet

Answer Engine Optimization ist die Praxis, Marke und Inhalt so aufzubereiten, dass Answer Engines sie verstehen, ihnen vertrauen, sie finden, zitieren und empfehlen können, wenn Nutzer Fragen stellen.

Verstehen heißt: Die Seite enthält klare Entities, Definitionen und Relationen. Wenn Produktkategorie, Zielgruppe, Use Case und Beleg im Marken-Blabla vergraben sind, wird das Extrahieren schwer.

Vertrauen heißt: Aussagen werden durch Quellen, Autorensignale, Marken-Konsistenz und externe Bestätigung gestützt. „Wir sind die führende Plattform“ hilft einer Answer Engine kaum. Wer hilft wem, welche Beweise stützen die Aussage, woher stammen die Daten – das hilft.

Finden heißt: Der Inhalt liegt im Korpus oder Index, aus dem die Engine zieht. Manche Systeme suchen live im Web, manche nutzen Search-APIs, manche antworten aus Model-Memory, manche mischen alles.

Zitieren heißt: Das System kann auf eine konkrete URL zeigen. Empfehlen heißt: Die Marke erscheint als sinnvolle Option, wenn der Nutzer fragt, was er kaufen, vergleichen oder testen soll.

„Erfolg sollte an Markenzitationen in Quellen oder Marken-Erwähnungen und Links innerhalb der LLM-Antworten gemessen werden.“

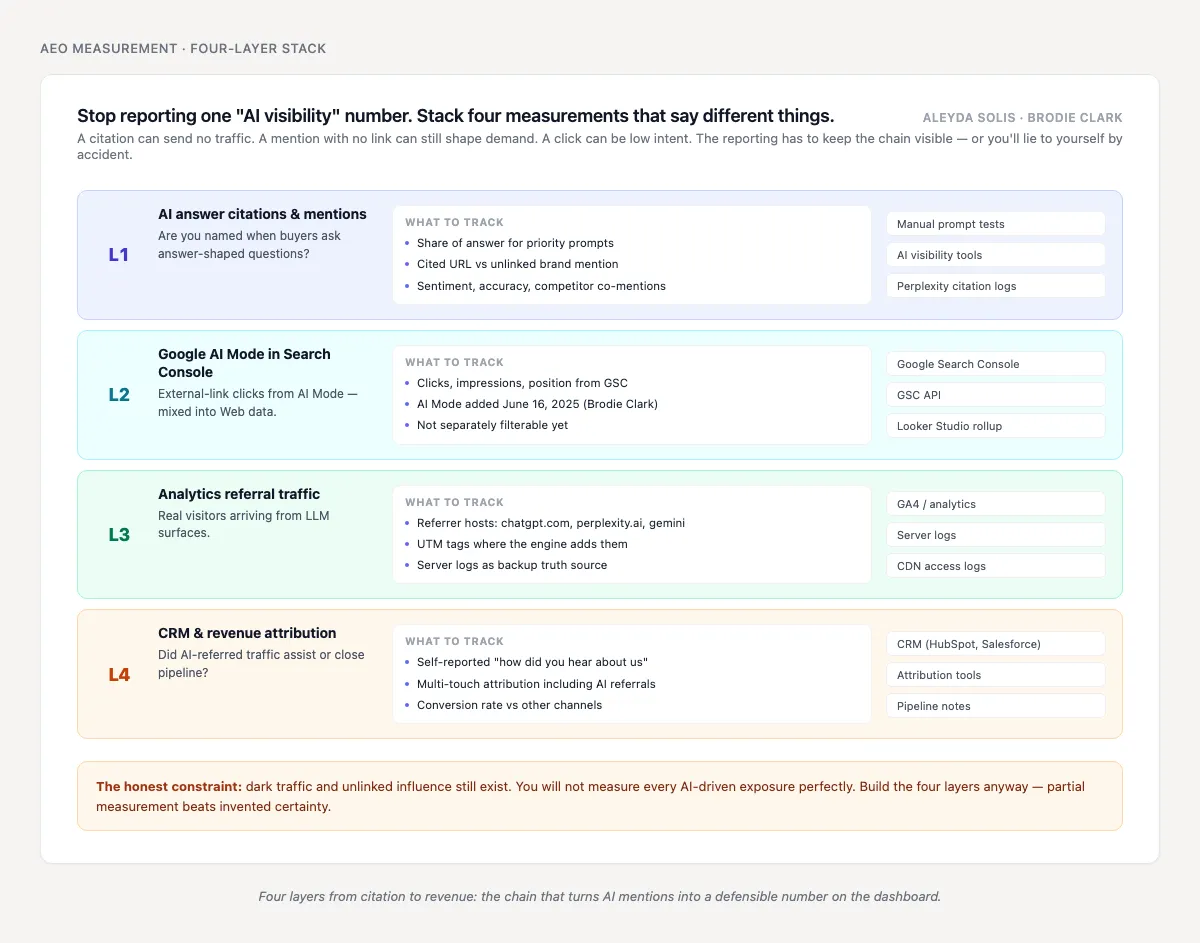

Aleyda Solis trifft den Messrahmen. Nicht jede KI-Antwort enthält Links. Darum muss AEO-Reporting Zitationen, Erwähnungen, Empfehlungen und tatsächliche Besuche trennen.

AEO optimiert für Auswahl

Ein Ranking-Report fragt: „Wo landete meine Seite?“ AEO fragt: „Hat das System meine Marke oder Quelle gewählt, obwohl es Alternativen gab?“ Das ist näher am heutigen Rechercheverhalten von Käufern (ChatGPT, Perplexity, Claude, Gemini, Google AI Mode).

Frage-Keywords sind nur der Einstieg. „Was ist Answer Engine Optimization?“ ist wichtig, aber das Geld steckt oft in Prompts wie „bestes Internal-Linking-Tool für SaaS-Blogs“, „SEO-Tool-Alternativen für kleine Teams“ oder „How to fix orphan pages at scale“.

Zitationen, Erwähnungen und Empfehlungen

Eine Zitation verweist auf eine URL. Eine Erwähnung nennt Ihre Marke. Eine Empfehlung bringt Ihre Marke in die engere Auswahl. Ein Klick bringt den Nutzer zu Ihnen. Eine Conversion beweist den Business-Wert.

Wer alles in einer Metrik zusammenfasst, belügt sich selbst. Eine Marken-Erwähnung ohne Link kann Nachfrage formen. Eine Zitation kann null Traffic schicken. Ein Klick kann low intent sein. Reporting muss die Kette sichtbar halten.

AEO vs. SEO vs. GEO vs. AISO

Der Akronym-Haufen ist ermüdend, teils auch Vendor-Marketing. Als Karte statt Revierkampf sind die Begriffe jedoch nützlich.

| Begriff | Primäre Oberfläche | Optimiert wird | Gemessen wird | Best-Case |

|---|---|---|---|---|

| SEO | Organische Ergebnisse in Google & Bing | Seiten, technischer Zugriff, Links, Content-Qualität | Rankings, Klicks, Conversions | Dauerhafte Suchnachfrage |

| AEO | Answer Engines & KI-Antworten | Antwortreife Quellen & Markenvertrauen | Zitationen, Erwähnungen, Links, Klicks | Direkte Antworten & Empfehlungen |

| GEO | Generative Engines | Content-Darstellung in generierten Antworten | Inklusion & Sichtbarkeit in Antworten | Forschung zu KI-Antwort-Einfluss |

| AISO | Breite AI-Search-Flächen | Misch-Sichtbarkeit in AI-Search | Cross-Plattform-Reporting | Dach-Planung |

AEO ist die buyer-orientierte Perspektive. GEO ist die Forschungs- und Systemebene. SEO bleibt die Infrastruktur. Wenn Ihre Seiten nicht crawlfähig, verständlich und vertrauenswürdig sind, rettet kein Dashboard-Akronym Sie.

Wann AEO der bessere Begriff ist

Nutzen Sie AEO, wenn die Nutzeraufgabe antwortförmig ist: definieren, vergleichen, auswählen, Troubleshooting, Shortlist. Hier ändert eine Nennung den Kaufpfad.

Nutzen Sie SEO, wenn es um Indexierung, Rankings, interne Links, Page-Updates und Conversion aus organischer Suche geht. Nutzen Sie GEO, wenn es um generierte Antworten über Modelle hinweg geht. Die Arbeit überlappt, die Messbrille wechselt.

Wie Answer Engines entscheiden, was sie zitieren

Außerhalb der Modell-Teams kennt niemand jede Retrieval-Regel, Gewichtung oder Citation-Policy. Wer anderes behauptet, verkauft Sicherheit, die er nicht hat. Ein nützliches Denkmodell ist dennoch möglich.

- Der Nutzer stellt eine Frage.

- Das System interpretiert Intent und Entities.

- Es ruft Kandidatenquellen ab oder greift auf Trainingswissen zu.

- Es vergleicht mögliche Antworten.

- Es schreibt eine Antwort.

- Es kann Quellen zitieren, Marken nennen oder beides.

Retrieval und Ranking sind getrennte Schritte

LLMs ranken Seiten nicht wie Googles klassische Ergebnisliste. Manche Answer Engines rufen das Web live ab, manche nutzen Search-Partner, manche antworten aus Model-Memory, manche mischen Quellen und zitieren nur einen Teil.

Das hat Folgen für Content. Eine Seite, die die Antwort unter fünf Absätzen Positionierungs-Blabla vergräbt, lässt sich schwer extrahieren. Eine Seite mit unbelegten Behauptungen ist leicht zu ignorieren. Eine Site mit schwacher interner Struktur erschwert das Bestätigen von Themenbezügen.

Markenkonsens schlägt Einzelbehauptung

Answer Engines suchen nach Bestätigung – nicht vor Gericht, sondern pragmatisch: wiederholte, konsistente Evidenz. Wenn Ihre Site etwas sagt, Review-Sites etwas anderes und Vergleichsseiten gar nichts, hat das System wenig Grund, Ihrer Version zu vertrauen.

Interne Links helfen. Sie erzwingen keine Zitation, erleichtern aber Crawlern und Retrieval-Systemen, welche Seiten welche Themen stützen. Definitions-, Vergleichs-, Methodik- und Source-Pages sollten sich gegenseitig stärken statt isoliert zu schweben.

Die AEO-Checkliste ist der Ort, an dem Teams sterben

Die Checkliste ist verführerisch. Sie wirkt sicher.

„SEO ist eine Checklisten-Kultur.“

Mike King schrieb das in Kapitel 16 des iPullRank-Werkes The AI Search Manual, und AEO wiederholt das Muster bereits. Schema, FAQs, Autoren-Bios, kurze Absätze, Zitationen, Entity-Pages, Reddit-Erwähnungen, „Best-X-Tools“-Seiten – alles kann helfen, nichts funktioniert als isolierter Hack.

Was tatsächlich einzahlt

FAQ-Blöcke helfen nur, wenn die zugrunde liegende Antwort nützlich ist. Schema labelt Content, schafft aber kein Vertrauen. Autoren-Bios stützen Autorität, retten aber keine dünnen Claims. Reddit-Threads zählen, wenn echte Nutzer diskutieren, nicht wenn jemand ein Fake-Gespräch seedet.

Die bessere Einstiegsfrage ist brutal: Wo würde eine Zitation eine Kaufentscheidung ändern?

Starten Sie dort. Wählen Sie Fragen mit Umsatzbezug. Bauen Sie dann Assets, die es verdienen, abgerufen, zitiert und empfohlen zu werden.

Was stattdessen tun: Answer Assets bauen

Answer Assets sind Seiten oder Abschnitte, die für Extraktion, Vertrauen und Zitation gebaut sind. Keine Blogposts im KI-Kostüm – sie beantworten eine echte Frage, nennen Entities klar, stützen Claims und verbinden sich mit dem Rest der Site.

Definitions-Assets

Ein Definitions-Asset sollte den Begriff in den ersten 80–120 Wörtern beantworten. Danach klärt es, was der Begriff umfasst, womit er verwechselt wird und wie er praktisch angewendet wird.

Schwache Version: „Unsere Plattform hilft Teams, organisches Wachstum zu transformieren.“ Stärkere Version: „Internal-Linking-Software findet Orphan-Pages, empfiehlt Kontext-Links und hilft Suchmaschinen zu verstehen, welche Seiten welches Topic-Cluster stützen.“ Zweite Version liefert der Answer Engine Stoff zum Extrahieren.

Vergleichs-Assets

Vergleichsseiten funktionieren, wenn sie Käufern helfen, auszuwählen. „Tool A vs. Tool B“-Content, der nur das eigene Produkt lobt, ist Sales Copy. Ein nützlicher Vergleich erklärt Passform, Trade-offs, Preismodell, Setup-Aufwand und Szenarien, in denen der Wettbewerber besser sein kann.

Hier werden Gründer oft nervös. Sie wollen jede Situation gewinnen. Käufer glauben das nicht. Modelle vermutlich auch nicht.

Evidence-Assets

Evidence-Assets sind Originaldaten, Research-Zusammenfassungen, Benchmarks, Customer-Patterns und Source-Hubs. Sie geben Answer Engines einen Grund, Ihre Seite einer generischen Erklärung vorzuziehen.

Auf vadimkravcenko.com sind die Seiten mit nachhaltiger Sichtbarkeit selten die cleveren. Sie beantworten die exakte Frage und verbinden sich mit einem größeren Themen-Korpus. Ich lerne das ständig neu. Cleveres Framing zieht eine Woche Aufmerksamkeit. Klare Quellenarbeit kumuliert.

Methodik- und Support-Seiten

Methodik-Seiten erklären, wie Ihr Produkt, Prozess oder Scoring funktioniert. Use-Case-Seiten verknüpfen diese Methode mit einer Zielgruppe. Glossar-Seiten definieren die Begriffe. Interne Links verbinden das Cluster.

Für seojuice.io heißt das: Eine Seite zu Orphan-Pages sollte sich mit Internal-Linking, Crawl-Depth, Topic-Clusters und Link-Equity verknüpfen. Die Produktseite darf nicht allein versuchen, die Kategorie zu erklären.

- Platzieren Sie die direkte Antwort weit oben.

- Nennen Sie Entities klar.

- Stützen Sie spezifische Claims mit Quellen.

- Nutzen Sie crawl-fähige URLs.

- Fügen Sie interne Links von verwandten Seiten hinzu.

- Zeigen Sie externe Belege, wo möglich.

- Geben Sie dem Modell einen Grund, Ihre Seite einem generischen Artikel vorzuziehen.

Wie man AEO misst, ohne sich zu belügen

AEO-Reporting ist unordentlicher als SEO-Reporting. Es ist jedoch nicht unergründlich. Man braucht getrennte Metriken für getrennte Ergebnisse.

| Metrik | Tool/Quelle | Sagt Ihnen | Sagt Ihnen nicht |

|---|---|---|---|

| Marken-Erwähnungen | Manuelle Prompt-Tests, AI-Visibility-Tools | Ob Ihre Marke in Antworten auftaucht | Ob der Nutzer geklickt oder gekauft hat |

| Quellen-Zitationen | Perplexity, ChatGPT-Zitationen, Google AI-Antworten | Welche URLs als Quellen dienen | Ob die Zitation überzeugte |

| Referral-Traffic | Analytics & Server-Logs | Besuche von LLM-Flächen | Unverlinkten Einfluss & Dark Traffic |

| Google AI Mode Klicks | Google Search Console | Externe-Link-Klicks aus AI Mode | Separate AI-Mode-Filterung |

| Pipeline-Impact | CRM & Attribution | Ob KI-Referrals Umsatz unterstützen | Jede Pre-Click-Exposure |

Was Google Search Console zeigen kann

Google fügte am 16. Juni 2025 AI-Mode-Tracking zu Search Console hinzu. Ein Klick auf einen externen Link im AI Mode zählt als Klick. Impressions und Position folgen den Standardregeln.

Der Haken: AI-Mode-Daten werden in Web-Daten gemischt und sind nicht separat filterbar. Brodie Clark bestätigte das mit einem Experiment über 20 000 Impressions: AI-Mode-Daten außerhalb von Labs werden im Performance-Report mit Web-Daten zusammengeführt.

Erstellen Sie erst ein Prompt-Set, dann ein Dashboard

Für ChatGPT, Perplexity, Claude und andere Answer Engines braucht man weiterhin Prompt-Tests, Citation-Tracking, Analytics-Tagging und CRM-Follow-up. Beginnen Sie mit einem kleinen Prompt-Set mit Umsatzbezug (2026 ist das Budget-Arbeit, kein Hobby).

Tracken Sie den „Share of Answer“ für Prioritäts-Prompts. Dokumentieren Sie Sentiment und Positionierung. Trennen Sie „erwähnt“ von „zitiert“. Screenshots helfen bei der Diagnose, taugen aber schwach als Beweis.

Ist AEO-Traffic überhaupt wertvoll?

AEO-Traffic ist real und qualifiziert, aber kein Cheat-Code.

Maximilian Kaiser und Christian Schulze veröffentlichten im April 2026 in Marketing Science eine Studie, die 12 Monate First-Party-Google-Analytics-Daten von 973 E-Commerce-Websites analysierte. Diese Sites standen für 20 Mrd. $ Jahresumsatz, über 50 000 organische LLM-Transaktionen und 164 Mio. Transaktionen aus klassischen Kanälen.

„Ein Jahr nach Launch weist oLLM eine höhere CR und RPS als Paid Social auf, aber niedrigere CR und RPS als fast alle traditionellen Kanäle.“

Übersetzt: In diesem Datensatz konvertierte organischer LLM-Traffic besser als Paid Social, aber schlechter als die meisten klassischen Kanäle. Komplexe Produktkategorien schnitten stärker ab (siehe Kaiser & Schulze für den Channel-Break-down).

Das deckt sich mit der Praxis. Komplexe Produkte profitieren zuerst, weil Käufer vor dem Handeln forschungsintensive Fragen stellen. B2B-Software, Consulting, Dev-Tools, Security, Finance und Healthcare passen dazu besser als Impulskäufe.

Die Zielgruppe ist groß genug. Das Pew Research Center meldete im Juni 2025 (Olivia Sidoti & Colleen McClain): 34 % der US-Erwachsenen nutzten ChatGPT, etwa doppelt so viele wie 2023. Bei 18- bis 29-Jährigen lag die Quote bei 58 %, bei 30- bis 49-Jährigen bei 41 %. Berufliche Nutzung stieg von 8 % auf 28 % in zwei Jahren.

Das ist das B2B-Signal: jung genug für Wachstum, arbeitsbezogen genug, um Kaufrecherche zu prägen, und bereits groß genug, um Ignorieren lazy wirken zu lassen.

Ein 30-Tage-AEO-Plan ohne Theater

Starten Sie nicht mit 500 Prompts. Sonst entsteht eine Tabelle, der niemand traut. Beginnen Sie klein genug, dass das Team Antworten manuell prüfen kann.

- Woche 1: Wählen Sie 20–40 umsatzrelevante Prompts. Inklusive Kategorie-, Vergleichs-, Problem- und „bestes Tool für X“-Prompts. Nutzen Sie die Sprache, die Käufer in Sales-Calls, Support-Tickets und Suchanfragen verwenden.

- Woche 2: Führen Sie die Prompts in den Haupt-Answer-Engines aus. Testen Sie ChatGPT, Perplexity, Claude, Gemini und Google AI Mode. Notieren Sie, ob Ihre Marke erscheint, Ihre URLs zitiert werden, welche Wettbewerber auftauchen und welche Claims die Antwort enthält.

- Woche 3: Bauen oder reparieren Sie Answer Assets. Starten Sie mit Seiten, die bereits Sichtbarkeit oder Conversion liefern. Fixen Sie Near-Win-Seiten vor neuen Inhalten.

- Woche 4: Stärken Sie das Source-Cluster. Fügen Sie interne Links hinzu, zitieren Sie bessere Quellen, räumen Sie vage Claims auf, aktualisieren Sie Autoren- und Firmeninfos und machen Sie die Antwort leichter extrahierbar.

Wiederholen Sie das monatlich. Modelle updaten, Retriever ändern sich, Citation-Verhalten kann ohne Vorwarnung umschwenken. Ich traue keinem Platform-Citation-Pattern als dauerhaft – nützlich, ja; stabil für immer, nein.

Häufige AEO-Fehler

Jede KI-Plattform gleichermaßen jagen

Ihre Käufer nutzen nicht jedes Tool gleich stark. Testen Sie anfangs breit, fokussieren Sie dann auf Flächen, die in Analytics, Sales-Gesprächen und Kundenresearch auftauchen.

Nur Referral-Traffic messen

Referral-Traffic übersieht unverlinkte Erwähnungen und Zero-Click-Einfluss. Ein Käufer sieht Ihre Marke in einer Antwort, sucht später nach ihr und kommt über Brand-Organic oder direkt.

Erwähnung und Zitation gleichsetzen

Erwähnung heißt, die Marke taucht auf. Zitation heißt, eine Quelle wurde genutzt. Empfehlung heißt, die Marke wird als Option positioniert. Halten Sie das getrennt.

Generische FAQ-Seiten veröffentlichen

FAQ-Seiten mit dünnen Antworten verdienen selten Zitationen. Fügen Sie FAQs hinzu, wo sie eine echte Seite klären. Machen Sie sie nicht zur Strategie.

Prompts optimieren, die Ihre Käufer nie stellen

Eitelkeits-Prompts liefern schicke Screenshots. Umsatz-Prompts decken Lücken auf. Wählen Sie die zweite Kategorie, auch wenn die erste schmeichelhafter ist.

FAQ

Was ist Answer Engine Optimization?

AEO ist die Praxis, Marke und Inhalt so aufzubereiten, dass KI-Answer-Engines sie verstehen, ihnen vertrauen, sie finden, zitieren und empfehlen können, wenn Nutzer Fragen stellen.

Unterscheidet sich AEO von SEO?

Ja, baut aber auf SEO auf. SEO schafft die crawlfähige, vertrauenswürdige Content-Basis. AEO fokussiert darauf, ob Answer Engines diesen Content in synthetisierten Antworten auswählen.

Ist AEO dasselbe wie GEO?

Sie überlappen. AEO ist die buyer-orientierte Perspektive auf Antworten, Zitationen und Empfehlungen. GEO beschreibt meist breiter die Sichtbarkeit in generativen Engines.

Wie werde ich von ChatGPT zitiert?

Erstellen Sie extrahierbare Seiten mit klaren Antworten, eindeutigen Entities, belegten Claims, crawl-fähigen URLs und externer Bestätigung. Testen Sie dann Prompts und tracken Sie, ob Ihre URLs als Quellen erscheinen.

Kann ich AEO in Google Search Console tracken?

Teilweise. AI-Mode-Klicks und ‑Impressions sind in den Web-Daten enthalten, AI Mode ist jedoch nicht separat filterbar. Für andere Answer Engines brauchen Sie eigene Tracking-Setups.

Lohnt sich AEO für kleine Sites?

Ja, wenn Sie gezielte Fragen anpeilen, bei denen Autorität erarbeitet werden kann. Kleine Sites gewinnen oft durch Klarheit, Spezifität und bessere Belege gegenüber generischen Publishern.

Beheben Sie die Quelle vor dem Dashboard

Das „Next Big Thing“-Framing verfehlt den Punkt. AEO ist das, worauf SEO immer zusteuerte – jetzt mit öffentlichen Antworten und härterem Feedback. Wenn eine Answer Engine nicht versteht, was Ihr Unternehmen tut, warum Ihre Seite vertrauenswürdig ist und welche Quelle die Aussage stützt, hat sie keinen Grund, Sie zu zitieren. Beheben Sie das, bevor Sie ein weiteres Dashboard kaufen.

Wenn interne Links Ihre Schwachstelle sind, starten Sie dort. seojuice.io hilft Teams, verwandte Seiten zu verbinden, Orphan-Content sichtbar zu machen und klarere Topic-Cluster aufzubauen – die Art von Quellstruktur, der Answer Engines wirklich folgen können.

Read More

no credit card required