TL;DR : les AI Overviews de Google font baisser les taux de clic de 30 à 60 % sur les requêtes concernées. Voici les données — et comment s’adapter.

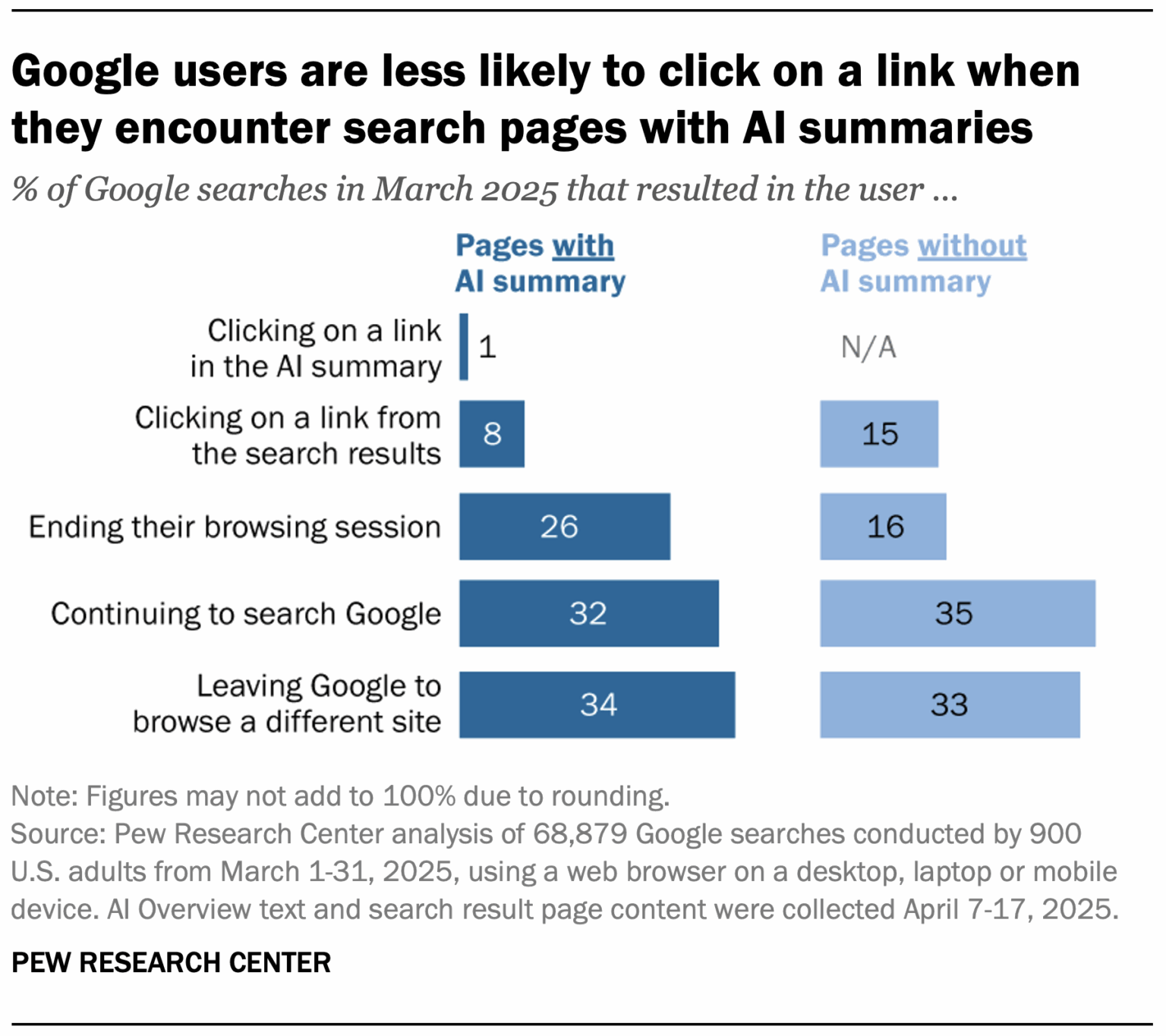

Imagine une page de résultats où un seul panneau supplémentaire — l’AI Overview, dans son encadré pastel — suffit à faire disparaître presque la moitié de tes visiteurs potentiels. C’est exactement ce qu’a mis en lumière le Pew Research Center en suivant 900 vrais utilisateurs en mars 2025. Sur une page Google classique, environ 15 % des gens cliquaient vers un site web. Ajoute un AI Overview, et le taux de clic tombe à 8 %.

Le calcul est brutal : pour mille recherches, tu viens de perdre soixante-dix clics — autant de visiteurs qui auraient pu arriver sur tes articles, tes fiches produit ou tes pages d’inscription. Pire, Pew a constaté que le bloc AI lui-même renvoie très rarement du trafic vers ses sources. À peine 1 % des résumés ont généré un clic sur une source citée, et quand ça arrivait, les gagnants étaient les géants — Wikipedia, YouTube, Reddit — pendant que les éditeurs de niche, la documentation SaaS et les blogs indépendants restaient sur le carreau.

Voilà ce que ça signifie concrètement pour notre activité : SEOJuice aide les sites à obtenir plus de trafic organique. Quand le principal mécanisme de découverte du contenu — cliquer sur un résultat de recherche — se réduit de moitié sur 20 % des requêtes, ce n’est pas un problème abstrait pour nous. C’est existentiel. On a passé les six derniers mois à repenser ce que veut dire « optimiser » quand la page de résultats répond elle-même à la question. Une partie de ce qu’on a appris est dans cet article. Une autre, on est encore en train de la démêler.

Les AI Overviews de Google s’affichent tout en haut de la page de résultats comme un featured snippet survitaminé, en piochant du texte sur plusieurs sites pour générer une réponse conversationnelle. La fonctionnalité a démarré sous le nom de Search Generative Experience (SGE) en mai 2023, visible uniquement pour des volontaires dans Google Labs. Au cours des douze mois suivants, l’entreprise a élargi SGE, en testant des suggestions de questions complémentaires, des liens shopping intégrés et des cartes de citation.

En mai 2024, Google a retiré l’étiquette « Labs » et a intégré les AI Overviews à l’interface de recherche par défaut aux États-Unis — d’abord sur un ensemble restreint de requêtes liées aux produits et de recherches de type tutoriel. Puis, chaque mois, le périmètre s’est élargi : recettes en août 2024, questions de santé en novembre, planification de voyage au début de 2025. En juillet 2025, BrightEdge et d’autres acteurs du suivi SEO estimaient que les AI Overviews apparaissaient sur environ 20 % de toutes les recherches desktop, avec une probabilité qui grimpait à 60 % pour les requêtes formulées comme des questions. Le bloc AI est devenu une deuxième page d’accueil — une page qui répond souvent avant même que l’utilisateur n’atteigne les liens bleus.

Pour quantifier l’impact, le Pew Research Center s’est associé au KnowledgePanel d’Ipsos, en équipant 900 adultes américains d’une extension de navigateur qui enregistrait chaque recherche Google effectuée en mars 2025. L’extension relevait :

Le texte de la requête et sa longueur (un seul mot, une expression ou une question complète).

La présence ou l’absence d’un AI Overview sur la SERP obtenue.

Les interactions utilisateur — profondeur de scroll, clics sur les liens et fait de terminer ou non la session sur la SERP.

Pew a ensuite comparé le comportement de clic sur les pages avec et sans le panneau généré par Gemini. Leur conclusion phare : les pages qui affichaient un AI Overview réduisaient presque de moitié les clics sortants — de 15 % à 8 %. Plus frappant encore, seulement 1 % de tous les AI Overviews ont généré un clic vers une source citée.

L’équipe PR de Google a rejeté l’étude, en affirmant que la taille de l’échantillon et un ensemble de requêtes biaisé déformaient la réalité du trafic global. Pew répond que sa méthodologie de panel opt-in est la même que celle à laquelle les chercheurs font confiance depuis deux décennies pour les sondages électoraux et les études sur la consommation des médias. Personnellement, je trouve que les données de Pew sont convaincantes sur le fond, même si j’aimerais voir une réplication à plus grande échelle. 900 participants, c’est significatif, mais pas définitif. Ce qui me les rend encore plus crédibles, c’est que les chiffres collent avec ce qu’on observe chez nos propres clients — des sites dans des niches informationnelles nous ont signalé des baisses de 25 à 45 % du CTR organique sur les requêtes où les AI Overviews apparaissent.

Les données de Pew transforment un an de spéculation en chiffres solides. La métrique principale : quand un AI Overview apparaît, la probabilité d’obtenir le moindre clic organique sur cette SERP passe de 15 % à 8 % — soit presque une division par deux.

Le fameux « dividende de trafic » promis par les citations existe à peine. Sur des milliers de blocs AI enregistrés, seulement 1 % ont généré ne serait-ce qu’un seul clic sur un lien de source cité. Dans 99 cas sur 100, la réponse AI satisfait l’utilisateur — ou l’arrête net — avant qu’un éditeur puisse récupérer la moindre page vue.

Les recherches formulées comme des questions — le cœur du contenu informationnel — sont précisément celles où le robot intervient : 60 % des requêtes posées sous forme de question déclenchent désormais un résumé AI.

Et les gains sont très concentrés. Trois destinations — Wikipedia, YouTube et Reddit — représentent 15 % de toutes les citations faites par le modèle, laissant les 85 % restants à se partager entre tous les autres sites du web. Cette concentration me gêne. Elle suggère qu’être « suffisamment bon » ne suffit plus — soit tu entres dans le cercle très fermé des sources citées par le modèle, soit tu te bats pour les miettes.

Le journal des citations de Pew ressemble à un concours de popularité biaisé en faveur de l’échelle et de la puissance communautaire. Les encyclopédies d’autorité (Wikipedia) et les mastodontes du contenu généré par les utilisateurs (vidéos YouTube, fils Reddit) dominent parce qu’ils offrent de vastes réservoirs de contenu, mis à jour en continu, auxquels le modèle peut faire confiance d’un point de vue statistique. Les méga-éditeurs avec un DR 90+ — pense à Mayo Clinic, The New York Times et Investopedia — apparaissent assez souvent pour préserver leur capital de marque.

Les victimes se trouvent dans la longue traîne : rédactions de niche, blogs SaaS spécialisés, revues académiques derrière un paywall et médias locaux. Ces sites apparaissent rarement dans le panneau AI, et même quand c’est le cas, les utilisateurs ne cliquent presque jamais. Même lorsqu’un petit éditeur publie l’info originale, Gemini la paraphrase souvent et attribue le mérite à une synthèse publiée par un site plus autoritaire ou à un forum communautaire.

Pour les marketers, la leçon est claire. Si tu n’es pas déjà dans le « cercle intérieur » des citations, compter uniquement sur le SEO traditionnel des liens bleus ne protégera pas ton trafic. La nouvelle frontière stratégique se déplace vers les données structurées, les blocs de réponse concis et les invitations explicites aux robots d’exploration AI — tout ce qui peut convaincre le modèle que tu mérites l’un des rares liens sortants qu’il distribue encore.

La nouvelle interface de Google récompense les sites qui alimentent ses modèles avec des données propres et vérifiables — et met discrètement les autres sur la touche. Aujourd’hui, trois priorités séparent les gagnants des orphelins du trafic.

1. Accueille les bots qui rédigent les réponses

Bloquer GPTBot, ClaudeBot, Perplexity-Bot ou Google-Extended, c’est l’équivalent moderne d’ajouter noindex à ta page d’accueil. Laisse les robots d’exploration reconnus tranquilles dans robots.txt (User-agent: * Allow: /) et désactive tout bouton « Block AI Scrapers » dans Cloudflare ou ton firewall. Le coût de crawl est dérisoire, mais chaque récupération réussie devient du carburant d’entraînement qui peut faire remonter ton paragraphe — avec un lien — dans le prochain milliard de requêtes conversationnelles. Nous avons écrit un guide détaillé pour corriger le réglage Cloudflare si tu ne sais pas trop comment faire.

2. Propose un bloc de réponse vérifié sur chaque page

Les AI Overviews piochent des affirmations concises, des étapes numérotées et des résumés à puces. Donne-leur exactement ça : un bloc de réponse de 40 à 60 mots près du haut de tes articles informatifs, encapsulé dans un <h2> du type « Réponse rapide ». Il doit être vérifiable — cite l’étude, indique l’année, fais un lien vers la source primaire — et évite le vernis promotionnel. C’est d’ailleurs le point sur lequel je suis vraiment le moins sûr côté bonnes pratiques. Nous avons testé ça sur environ 40 pages client, avec des résultats mitigés — 60 % ont montré une meilleure obtention d’extrait, mais les 40 % restants n’ont vu aucun changement. Les données sont prometteuses, pas encore concluantes.

3. Mise davantage sur les requêtes de marque et l’E-E-A-T

Si les clics génériques se tarissent, protège — et développe — le trafic que tu possèdes vraiment : les recherches qui incluent ton nom de marque. Optimise les balises title et les meta descriptions pour associer la marque à tes sujets clés. Renforce l’E-E-A-T en ajoutant des bios auteurs avec leurs qualifications, en liant vers des sources académiques ou scientifiques reconnues, et en maintenant un horodatage transparent « Dernière révision ». Plus ton autorité perçue est forte, plus l’AI de Google a de chances de te citer plutôt qu’un fil de forum.

Les chiffres de Pew sont le canari dans la SERP : les clics s’évaporent partout où des réponses AI apparaissent, et le périmètre ne cesse de s’étendre. Les sites qui coopèrent avec des robots fiables, présentent leur expertise dans des formats faciles à citer et renforcent leur autorité de marque continueront à gagner en visibilité — à la fois dans les liens bleus traditionnels et à l’intérieur même des blocs AI.

Tous les autres risquent de devenir de simples données d’entraînement en arrière-plan, connues du modèle mais jamais visitées par l’utilisateur. C’est une forme assez étrange de célébrité : être célèbre et invisible en même temps. Adapte dès maintenant ton playbook SEO à cette réalité dominée par l’AI.

Lectures associées :

no credit card required

No related articles found.